阿里云推出大规模视觉语言模型Qwen-VL

8月26日消息,阿里云推出大规模视觉语言模型Qwen-VL,一步到位、直接开源。

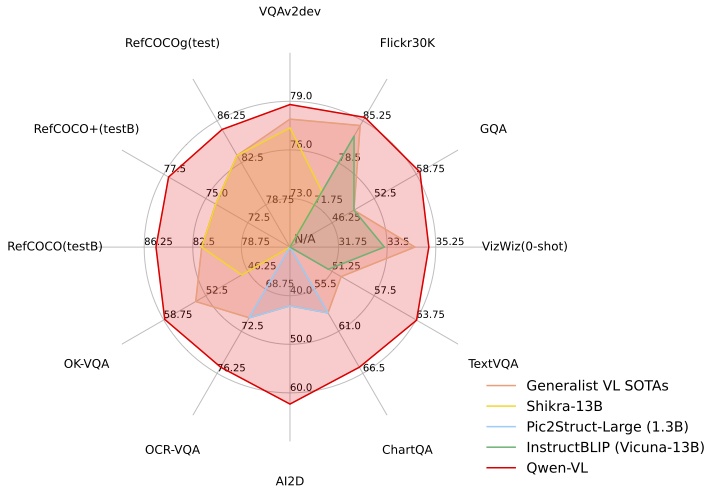

Qwen-VL以通义千问70亿参数模型Qwen-7B为基座语言模型研发,支持图文输入,具备多模态信息理解能力。在主流的多模态任务评测和多模态聊天能力评测中,Qwen-VL取得了远超同等规模通用模型的表现。

Qwen-VL是支持中英文等多种语言的视觉语言(Vision Language,VL)模型,相较于此前的VL模型,Qwen-VL除了具备基本的图文识别、描述、问答及对话能力之外,还新增了视觉定位、图像中文字理解等能力。

(图源阿里云公众号,下同)

多模态是通用人工智能的重要技术演进方向之一。业界普遍认为,从单一感官的、仅支持文本输入的语言模型,到“五官全开”的,支持文本、图像、音频等多种信息输入的多模态模型,蕴含着大模型智能跃升的巨大可能。多模态能够提升大模型对世界的理解程度,充分拓展大模型的使用场景。

视觉是人类的第一感官能力,也是研究者首先想赋予大模型的多模态能力。继此前推出M6、OFA系列多模态模型之后,阿里云通义千问团队又开源了基于Qwen-7B的大规模视觉语言模型(Large Vision Language Model, LVLM)Qwen-VL。Qwen-VL及其视觉AI助手Qwen-VL-Chat均已上线ModelScope魔搭社区,开源、免费、可商用。

用户可从魔搭社区直接下载模型,也可通过阿里云灵积平台访问调用Qwen-VL和Qwen-VL-Chat,阿里云为用户提供包括模型训练、推理、部署、精调等在内的全方位服务。

Qwen-VL可用于知识问答、图像标题生成、图像问答、文档问答、细粒度视觉定位等场景。

Qwen-VL以Qwen-7B为基座语言模型,在模型架构上引入视觉编码器,使得模型支持视觉信号输入,并通过设计训练过程,让模型具备对视觉信号的细粒度感知和理解能力。Qwen-VL支持的图像输入分辨率为448,此前开源的LVLM模型通常仅支持224分辨率。在Qwen-VL 的基础上,通义千问团队使用对齐机制,打造了基于LLM的视觉AI助手Qwen-VL-Chat,可让开发者快速搭建具备多模态能力的对话应用。

2、电商号平台仅提供信息存储服务,如发现文章、图片等侵权行为,侵权责任由作者本人承担。

3、如对本稿件有异议或投诉,请联系:info@dsb.cn