蚂蚁数科CTO王维:AI亟待提升专业性和可信性

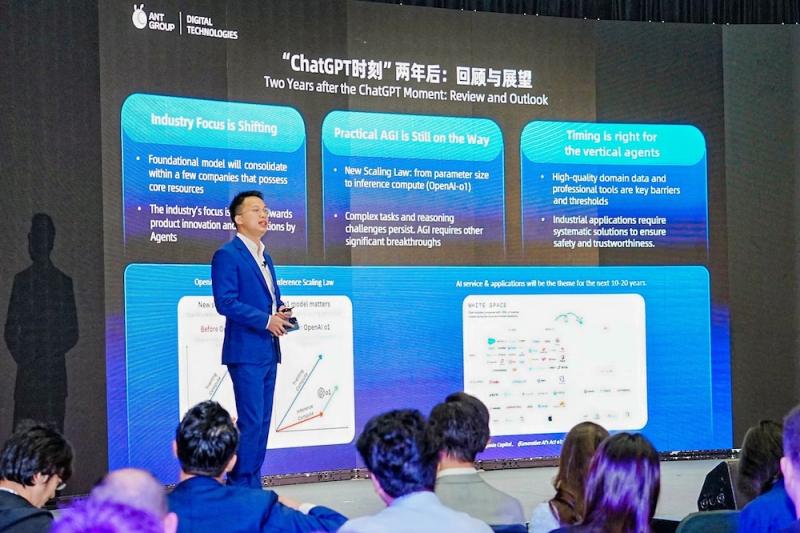

10月30日消息,蚂蚁数科CTO王维在香港金融科技周2024分享时指出,“大模型的应用从‘上新品’逐渐进入‘强应用’阶段,更好的通用人工智能仍在路上。”

两年前,大语言模型(LLM)的出现,引发了全球科技从业者的普遍关注和行业热潮。经过一段时间的狂奔,LLM性能阶段性趋于饱和,大模型底层推动力逐渐收敛到少数拥有核心数据及算力资源的公司,行业注意力也更多转到了以Agent为代表的行业应用侧。

如何解放LLM应用的局限性?王维强调,高质量的行业数据和专业工具是AI继续发展的关键壁垒和门槛,行业应用需要系统性地解决专业严谨和安全可信等问题。蚂蚁数科“蚁天鉴”产品集大模型安全测评与防御为一体,让大模型在生产和使用过程中更安全、可控、可靠。

图源:蚂蚁数科

王维认为,高质量数据可以更好地模拟客观世界,提升模型的准确性和稳定性。在过去十年,伴随着AI发展的范式转移,对数据的要求也在改变。机器学习从“以模型为中心”转向“以数据为中心”。在当下的LLM时代,行业应用要做到安全可信,其核心是如何结合专业人工+AI算法的高效标注,产生高质量的标注数据。

面向未来的AGI时代,随着互联网公开数据逐步耗尽,以及GPT-o1带来的强化学习训练新范式,都预示着数据合成的重要性进一步提升。王维指出,如何通过仿真引擎、自博弈(self-play)强化学习的方式,合成出更多互联网所不覆盖的高质量、高价值领域数据,将是到达AGI时代的关键。

图源:蚂蚁数科

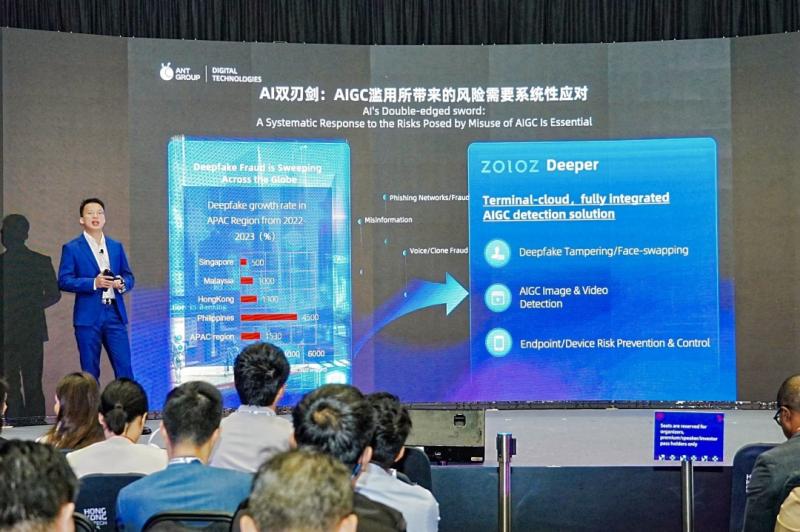

王维也提醒道,AI是把双刃剑,AIGC滥用所带来的风险需要系统性应对。AIGC的滥用不仅会产生虚假信息和网络钓鱼攻击,还可能引发全球性的诈骗活动。其中,值得关注的一大风险来源便是Deepfake, 即基于深度学习算法,从大量的视频和图像数据中学习,伪造出逼真的面部动画和语音。

蚂蚁数科旗下身份安全品牌ZOLOZ为此专门研发了综合防控产品ZOLOZ Deeper,以应对在开户、登录、支付等各种场景的深度伪造风险。在服务印尼某头部银行后,产品上线一个月时间内实现了Deepfake风险“0漏过”。

2、电商号平台仅提供信息存储服务,如发现文章、图片等侵权行为,侵权责任由作者本人承担。

3、如对本稿件有异议或投诉,请联系:info@dsb.cn